Precauciones, accidentes y responsabilidades

By Enrique Dans

El reciente atropello de Elaine Herzberg por parte de un Volvo XC90 autónomo que formaba parte de la flota de Uber en Arizona es una desgracia que debería hacernos reflexionar sobre el concepto de responsabilidad en el desarrollo tecnológico.

A falta de conclusiones definitivas de la investigación de la National Transportation Safety Board, todo parece indicar que la gestión del programa de conducción autónoma de Uber distó mucho de ser mínimamente responsable. Como bien analiza Brad Templeton en su página personal, las cosas pintan muy mal para la compañía. Nadie niega que la víctima estuviese cruzando indebidamente y de manera irresponsable por un lugar mal iluminado y no señalizado, pero a medida que más expertos analizan las abundantes pruebas documentales – no olvidemos que hablamos de un vehículo completamente sensorizado – más parece cundir la idea de que el vehículo de Uber no protegió al peatón de la manera mínimamente esperable, y que la compañía estaba, de manera deliberada, acelerando las pruebas por encima de sus posibilidades con el fin de recortar el tiempo necesario para lanzar un servicio comercial de transporte de vehículos sin conductor.

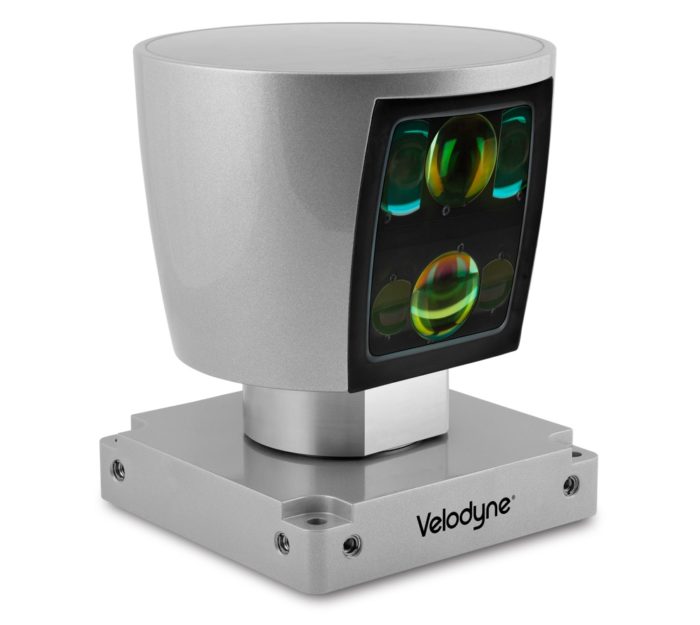

Las primeras sospechas surgen en torno a la falta de una reacción del vehículo, que no llegó a activar sus frenos. El fabricante del radar de láser pulsado (LiDAR) del vehículo, Velodyne LiDAR, una compañía independizada de su matriz, Velodyne, en 2016, participa en más de veinticinco programas de desarrollo de conducción autónoma con compañías como Volvo, Ford, Mercedes-Benz, Tencent, DJI, Baidu, TomTom, Here, Bing o SAIC, se ha mostrado completamente sorprendida por los datos del accidente que han trascendido hasta el momento, y ha situado la responsabilidad no en sus componentes, sino en algún otro punto. En un correo electrónico, Martha Thoma Hall, presidente y Chief Business Development Officer, se ha defendido afirmando que

We are as baffled as anyone else (…) Certainly, our LiDAR is capable of clearly imaging Elaine and her bicycle in this situation. However, our LiDAR doesn’t make the decision to put on the brakes or get out of her way (…) it is up to the rest of the system to interpret and use the data to make decisions. We do not know how the Uber system of decision-making works.

(Estamos tan desconcertados como cualquiera (…) En efecto, nuestro LiDAR es capaz de obtener imágenes claras de Elaine y de su bicicleta en una situación así. Sin embargo, nuestro LiDAR no toma la decisión de frenar o de salirse de su camino (…) corresponde al resto del sistema interpretar y utilizar los datos para tomar decisiones. No sabemos cómo funciona el sistema de Uber para la toma de esas decisiones.)

Los datos disponibles sobre el programa de conducción autónoma de Uber palidecen cuando se comparan con las cifras obtenidas por compañías como Waymo, por varios órdenes de magnitud. En noviembre de 2017, por ejemplo, los vehículos de Waymo eran ya capaces de recorrer casi 50,000 kilómetros sin ningún tipo de intervención humana. Los de Cruise (compañía adquirida por GM en 2016) declaraban, en octubre del mismo año, haber reducido esas intervenciones a tan solo tres en casi 45,000 kilómetros. En el caso de Uber, sus conductores de seguridad necesitaban tomar los mandos del vehículo en torno a una vez cada veinte kilómetros, una cifra comparativamente tan baja que posiblemente justificaría que sus vehículos estuviesen aún en fase de pruebas en circuito, no en tráfico real. En marzo de 2017, el número de intervenciones del conductor en vehículos de Uber era de una cada aproximadamente 1.3 kilómetros. ¿Qué dice Uber al respecto? Simplemente, que la métrica del número de intervenciones por distancia recorrida no es un buen indicador para valorar la seguridad de un vehículo autónomo. En efecto, es posible que una métrica no recoja la totalidad de la información… pero sí es significativo que esa métrica en concreto sea una basura.

La presencia de un conductor de seguridad, por otro lado, debería marcar la diferencia: todas las compañías parecen utilizar como conductores de seguridad a conductores normales que simplemente han pasado un determinado período de instrucción, con cursos de capacitación que suelen extenderse durante tres semanas, y que incluyen una prueba de conducción manual, una evaluación escrita, capacitación en el aula y en carretera, y en los que se valoran, por ejemplo, cuestiones como el tiempo de reacción, la experiencia militar, la experiencia como conductor de reparto, la capacidad para teclear más de cincuenta palabras por minuto, o para llevar a cabo revisiones básicas del vehículo. Un conductor de seguridad suele cobrar en torno a $23 por hora en Cruise o $20 en Waymo, un dato que se desconoce en el caso de Uber. La compañía utiliza unos cuatrocientos de esos conductores en los doscientos vehículos que tiene en sus flotas en Pittsburgh, Phoenix, Toronto, Tempe y San Francisco. En el caso de Rafaela Vasquez, la conductora implicada en el accidente, el hecho de que fuese una ex-convicta por delitos como robo y falsificación documental por los que cumplió condena durante cuarto años ha hecho que algunos apunten a una falta de responsabilidad de la compañía, aunque en realidad, el delito había sido cometido en el 2000, mantenía antecedentes limpios desde entonces, y además, la compañía mantiene una política de segundas oportunidades y únicamente excluye a quienes tienen delitos en los siete años anteriores.

¿Qué lleva a Uber a tratar de acelerar el desarrollo de la tecnología de conducción autónoma por encima de sus posibilidades? En primer lugar, la fuerte dependencia de la astronómica valoración de la compañía del hecho de que sea capaz de eliminar el principal componente del coste de operación de sus vehículos, el conductor. En segundo lugar, los recientes cambios en su dirección: todo indica que Dara Khosrowshahi, el CEO que sucedió al polémico fundador, Travis Kalanick, se inclinaba a su llegada a la compañía por la posibilidad de cancelar el programa de conducción autónoma, pero fue convencido por otros directivos para continuar con él, dada su gran importancia para el futuro de la compañía y el peso que podría tener en su valoración. El nuevo CEO tenía anunciada una visita a Arizona el próximo abril, y los responsables del programa pretendían ofrecerle una experiencia de conducción autónoma sin ningún tipo de incidentes y con pruebas en situaciones excepcionales (los llamados edge cases, que el propio Khosrowshahi había señalado como el auténtico reto) a bordo de uno de sus vehículos, lo que podría haber sido un factor importante a la hora de precipitar las pruebas. La compañía comenzó a privilegiar la acumulación de más millas frente a las pruebas con pasajeros, cambió la consideración de los conductores de seguridad, y fusionó a los encargados de pruebas de conducción en circunstancias complejas con los encargados de transportar pasajeros, al tiempo que redujo la dotación de los vehículos de dos conductores a uno. Así, la compañía fue capaz de pasar desde el primer millón de millas recorridas durante el año que terminó en septiembre de 2017, a conseguir el segundo millón en tan solo cien días, y a apuntar hacia el tercer millón en un plazo aún menor, tratando de dotar a sus algoritmos de más datos para su aprendizaje. Otras compañías, como Waymo, parecen haber sido mucho mas rigurosas a la hora de entrenar estos algoritmos en situaciones que no conllevasen peligro para las personas, como revela el uso de entornos de videojuegos para generar experiencias de este tipo.

¿Fue irresponsable la gestión del programa de conducción autónoma de Uber? Tratar de especular y extraer conclusiones antes de que termine la investigación de la NTSB es no solo temerario, sino innecesario: en el caso de un vehículo autónomo, no van a faltar datos que permitan analizar de manera fehaciente qué ocurrió, por qué, y a quién corresponde la responsabilidad. Pero a la hora de juzgar este tipo de temas, conviene separar el desarrollo de la tecnología como tal, de la gestión del mismo a la hora de ponerla en el mercado por parte de compañías que puedan actuar de manera potencialmente irresponsable. Pocos dudan de que la conducción autónoma es el futuro: cada vez son más los países en los que se autorizan pruebas de conducción autónoma, y las compañías responsables que demuestran que esas pruebas pueden llevarse a cabo en condiciones adecuadas de seguridad. Lo importante, a estas alturas, es evitar que paguen justos por pecadores, y que una tecnología con un potencial enorme a la hora de reducir accidentes, de proporcionar movilidad de manera ubicua o de mejorar el tráfico en las ciudades pueda seguir progresando adecuadamente. La forma de salvar vidas no es dificultando el progreso de esta tecnología, sino posibilitándolo, dentro de los lógicos límites de responsabilidad. Como en tantas otras ocasiones, el peligro no está en la tecnología, sino en la manera en que se utiliza.

Puedes leer el artículo completo en: : Precauciones, accidentes y responsabilidades